Membres

ITM Management : Détecter les faux contenus et les arnaques vocales à l’ère du numérique

Alors qu’octobre, le mois de la sensibilisation à la cybersécurité touche à sa fin, il est bon de rappeler que les plus grands risques numériques d’aujourd’hui ne sont plus uniquement techniques, mais psychologiques.

Des deepfakes générés par l’IA aux appels vocaux clonés (vishing), les cybercriminels exploitent désormais davantage la confiance, les émotions et les liens humains que les pare-feux ou les mots de passe. Ces arnaques sont conçues pour manipuler les émotions, usurper l’identité de personnes de confiance et vous pousser à prendre de mauvaises décisions. Ce qui est inquiétant, c’est à quel point ces manipulations peuvent sembler réelles, une voix familière, un visage connu égal une vidéo convaincante.

La clé de la protection ne réside pas seulement dans des systèmes plus solides, mais aussi en vous : votre vigilance, votre esprit critique et votre capacité à prendre le temps de vérifier et de poser les bonnes questions avant d’agir.

Le piège de l’émotion : peur, urgence, indignation, excitation.

Les escrocs ont compris qu’il est plus facile de pirater vos émotions que votre ordinateur. Il leur suffit d’une histoire qui semble assez crédible pour vous faire agir avant de réfléchir. Tout se joue en quelques secondes. Un message inattendu. Un appel inquiétant. Une alerte frauduleuse parfaitement imité et soudain, votre calme et votre logique disparaissent. C’est un vendredi après-midi. Le bureau est calme et vous essayez de vider votre boîte mail avant de partir. Soudain, un nouveau message apparaît. Il semble venir de votre directeur financier. La signature correspond parfaitement, mais le ton du message est sérieux :

« Nous avons un virement de dernière minute à effectuer aujourd’hui. Le PDG l’a approuvé personnellement. Merci de le traiter immédiatement et de garder cela confidentiel. »

Vous ne voulez pas être celle ou celui qui retarde une transaction ou remet en question un ordre hiérarchique. La pression monte, le ton est urgent, la demande paraît légitime. Alors, vous agissez. Vous confirmez le transfert. Et le lundi matin, les fonds et l’expéditeur ont disparu. Voilà comment cela arrive. Non pas à cause d’un pare-feu défaillant ou d’un mot de passe faible, mais à cause de la plus humaine des vulnérabilités : l’instinct de répondre, de plaire, de protéger, d’agir vite.

A. Les deepfakes

Les deepfakes sont des vidéos ou images créées à l’aide de l’intelligence artificielle, prenant l'apparence de personnalités connues ou bien de personnes que vous connaissez. Ces dernières deviennent de plus en plus réalistes et difficiles à détecter, et sont conçues pour exploiter des émotions humaines comme la peur, la curiosité ou la compassion afin de vous faire réagir avant de réfléchir.

Les escroqueries utilisant des deepfakes peuvent prendre la forme de :

- Une fausse vidéo d’un PDG demandant à un employé d’effectuer un paiement urgent.

- Un clip d’actualité truqué diffusant de fausses informations pour manipuler l’opinion publique.

- Un appel vidéo falsifié usurpant l’identité d’un partenaire commercial, client ou membre de la famille.

Comment se protéger ?

En apprenant à douter, pas de manière cynique, mais réfléchie. Vous n’avez pas besoin d’être un expert en technologie pour repérer un deepfake : il suffit de rester attentif et de poser les bonnes questions.

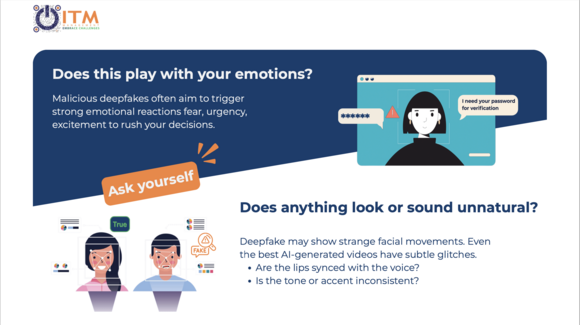

Cela joue-t-il sur vos émotions ?

Les deepfakes malveillants visent souvent à provoquer une émotion peur, excitation ou urgence pour vous faire réagir. Si un contenu vous paraît trop émotionnel, faites une pause. Demandez-vous pourquoi il a été créé et à qui profite votre réaction. Une recherche rapide du sujet accompagnée du mot « arnaque » peut souvent révéler s’il est authentique.

Repérer l’artificiel

Même si la technologie des deepfakes s’est beaucoup améliorée, elle laisse encore des indices subtils. La personne peut cligner des yeux de manière étrange, bouger les lèvres sans synchronisation parfaite avec la voix, avoir des expressions un peu robotiques ou un éclairage incohérent avec l’arrière-plan.

Dans les arnaques basés sur la voix, écoutez attentivement : le son peut sembler plat, mécanique ou présenter des pauses et intonations inhabituelles. Si votre instinct vous dit que quelque chose cloche il a probablement raison.

L’importance de la source

Les deepfakes et fausses informations proviennent rarement de sources fiables. Elles circulent souvent via des comptes anonymes, des sites inconnus ou des messages privés sans mention d’auteur. Les contenus crédibles comportent des détails comme la date de publication, le nom de l’auteur ou un lien vers une organisation officielle. Si vous ne reconnaissez pas la source, restez prudent. Les organisations fiables n’ont rien à cacher. Elles sont transparentes sur leur identité et l’origine de leurs contenus.

Vérifiez si l’histoire existe ailleurs

Une information réelle peut être facilement vérifiée : elle apparaîtra sur plusieurs sites réputés et sera rapportée par différents journalistes partageant les mêmes faits (noms, dates, lieux). Les fausses histoires, vivent souvent en vase clos. Si vous ne trouvez une affirmation que sur un seul post ou dans un groupe privé, c’est un signal d’alerte.

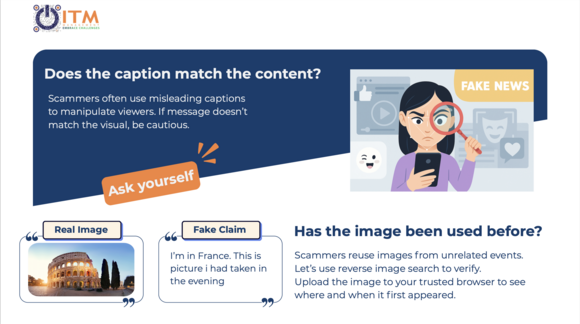

Quand les légendes mentent

Parfois, ce n’est pas la vidéo qui est fausse, mais sa légende. Les escrocs associent souvent des images réelles à de fausses descriptions pour semer la confusion ou susciter la colère.Le meilleur moyen de vérifier est de rechercher quand et où la vidéo a été publiée pour la première fois. Si l’image et la légende ne correspondent pas, c’est probablement une manipulation.

Images réelles, faux contexte

Recycler de vieilles photos est un classique. Une recherche d’image inversée permet de voir si une photo a déjà été publiée ailleurs sous un autre contexte.

B. Vishing et clonage vocal : Ne croyez pas tout ce que vous entendez et restez vigilant face à ces signaux d’alertes

Si le phishing par e-mail est bien connu, le vishing (hameçonnage vocal) devient discrètement l’une des tactiques les plus dangereuses des cybercriminels et l’IA le rend encore plus crédible. Imaginez recevoir un appel qui semble venir de votre supérieur ou de votre enfant, demandant une aide urgente. La voix est la même, ton, rythme, expressions. Vous ne doutez pas : c’est bien elle ou lui. Mais non, c’est un clone numérique. Ces arnaques reposent sur l’urgence et l’émotion pour contourner la logique. Elles peuvent dire :

« Je suis à l’hôpital, il faut transférer de l’argent pour les examens médicaux. »

« Nous avons un paiement d’urgence à effectuer immédiatement. »

La nouveauté : le clonage vocal par IA

Le vishing moderne ne se limite plus à de faux techniciens du support client. Les escrocs peuvent désormais cloner de vraies voix à partir de vidéos YouTube, podcasts ou publications sur les réseaux sociaux.

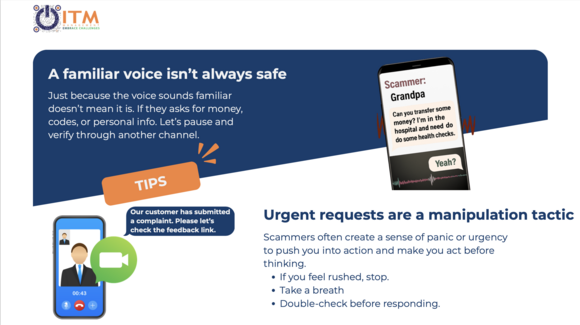

Une voix familière n’est pas toujours sûre

Ce n’est pas parce qu’une voix semble authentique qu’elle l’est. Si quelqu’un vous demande de l’argent, des codes ou des données personnelles faites une pause et vérifiez par un autre canal.

Les demandes urgentes sont une tactique de manipulation

La plupart des arnaques vocales reposent sur la panique. Le but est de vous faire agir sans réfléchir. Les vraies organisations ne demandent jamais de paiements immédiats ou d’informations confidentielles par téléphone.

Comment vérifier en toute sécurité

Si un appel vous semble suspect, ne répondez pas tout de suite. Rappelez la personne à son numéro officiel ou contactez votre supérieur ou le service informatique. Ne rappelez jamais le numéro communiqué par l’appelant.

Créer un mot de sécurité

Certaines familles ou équipes mettent en place un mot de sécurité secret une phrase connue uniquement des membres de confiance. Si quelqu’un prétend être un proche ou un collègue, demander ce mot permet de vérifier immédiatement son identité.

Ne partagez jamais d’informations sensibles par téléphone

Les entreprises ne demandent jamais de mots de passe, de codes ou de données financières par téléphone. Si c’est le cas raccrochez. C’est une tentative de vishing.

Conseil final :

Les deepfakes et le vishing montrent comment l’IA peut être utilisée pour manipuler la confiance. Ces menaces ne ciblent plus seulement vos boîtes mail, mais votre instinct alors votre reflexion reste désormais votre meilleure défense.

Vous n’avez pas besoin d’être un expert pour rester en sécurité. Il suffit de ralentir, poser des questions et vérifier avant de faire confiance. Qu’il s’agisse d’une vidéo, d’une image ou d’un appel, si quelque chose semble étrange, c’est probablement le cas.

La vigilance humaine : le meilleur pare-feu

Nous aimons croire que la technologie nous protège, pare-feux, antivirus, mais derrière chaque clic, il reste une barrière essentielle : vous. La technologie détecte les menaces, mais les humains sont la première et la dernière ligne de défense. Les escroqueries propulsées par l’IA ciblent les émotions parce qu’elles savent que la vigilance est souvent notre point faible mais elle peut aussi devenir notre plus grande force. En ralentissant, en questionnant les demandes inhabituelles et en vérifiant les sources, nous brisons la chaîne de manipulation.

ITM, met en avant la philosophie suivante : « Une technologie intelligente nécessite des utilisateurs intelligents. », leur objectif est clair, aider les organisations à développer une culture cyber-résiliente, où chaque employé devient un pare-feu humain vigilant, informé et prêt à réagir.

Transformons la sensibilisation en action :

- Commencez par parler cybersécurité au travail, à la maison et dans votre communauté.

- Encouragez les autres à réfléchir avant de cliquer, à vérifier avant de faire confiance et à questionner avant d’agir.

- Ralentissez, posez des questions et vérifiez avant d’accorder votre confiance.

ITM soutient les entreprises à travers :

- Des formations de sensibilisation à la sécurité pour éduquer et responsabiliser les employés.

- Des solutions de protection et de sauvegarde des données pour sécuriser les informations critiques.

- Une surveillance proactive des menaces pour identifier et bloquer les attaques avant qu’elles ne causent des dommages.

Contactez ITM Management pour découvrir comment renforcer les défenses de votre organisation et construire un futur où l’humain et la technologie évoluent ensemble en toute sécurité.